全球最大开源视频模型,现在也 Created in China了,阶跃出品

作者:衡宇 发自 凹非寺

图片来源:由无界AI生成

刚刚,阶跃星辰联合吉利汽车集团,开源了两款多模态大模型!

新模型共2款:

-

全球范围内参数量最大的开源视频生成模型Step-Video-T2V

-

行业内首款产品级开源语音交互大模型Step-Audio

多模态卷王开始开源多模态模型,其中Step-Video-T2V采用的还是最为开放宽松的MIT开源协议,可任意编辑和商业应用。

(老规矩,GitHub、抱抱脸、魔搭直通车可见文末)

在两款大模型的研发过程中,双方在算力算法、场景训练等领域优势互补,“显著增强了多模态大模型的性能表现”。

从官方公布的技术报告来看,这次开源的两款模型在Benchmark中表现优秀,性能超过国内外同类开源模型。

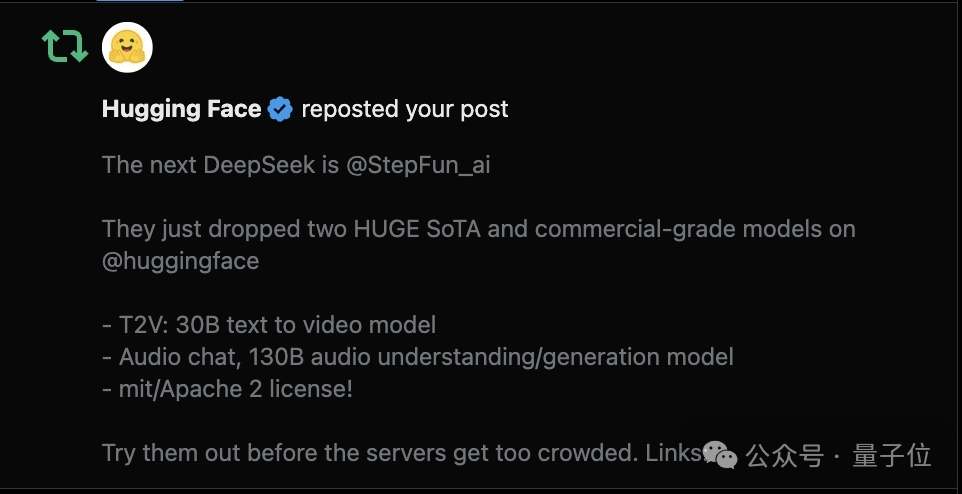

抱抱脸官方也转发了中国区负责人给予的高度评价。

划重点,“The next DeepSeek”、“HUGE SoTA”。

哦,是吗?

那量子位可要在本篇文章中掰开技术报告+一手实测,看看它们是否名副其实。

量子位求证,目前,本次2款新的开源模型都已接入跃问App,人人可以体验。

多模态卷王首次开源多模态模型Step-Video-T2V和Step-Audio,是阶跃星辰首次开源的多模态模型。

Step-Video-T2V先来看看视频生成模型Step-Video-T2V。

它的参数量达到30B,是目前已知全球范围内参数量最大的开源视频生成大模型,原生支持中英双语输入。

官方介绍,Step-Video-T2V共有4大技术特点:

第一,可直接生成最长204帧、540P分辨率的视频,确保生成的视频内容具有极高的一致性和信息密度。

第二,针对视频生成任务设计并训练了高压缩比的Video-VAE,在保证视频重构质量的前提下,能够将视频在空间维度压缩16×16倍,时间维度压缩8倍。

当下市面上多数VAE模型压缩比为8x8x4,在相同视频帧数下,Video-VAE能额外压缩8倍,故而训练和生成效率都提升64倍。

第三,针对DiT模型的超参设置、模型结构和训练效率,Step-Video-T2V了进行深入的系统优化,确保训练过程的高效性和稳定性。

第四,详细介绍了预训练和后训练在内的完整训练策略,包括各阶段的训练任务、学习目标以及数据构建和筛选方式。

分享链接: - 区块链日报

免责声明:本站所有内容不构成投资建议,币市有风险、投资请慎重。